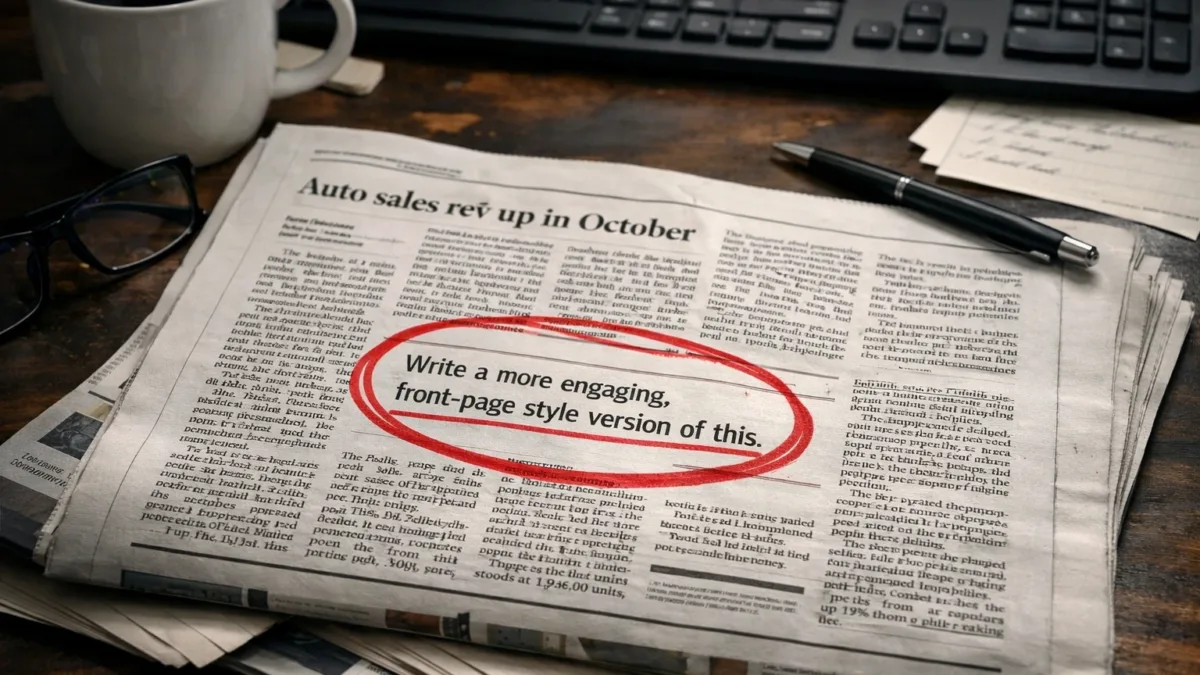

- Wszystko rozbiło się o tekst „Auto sales rev up in October”.

- W papierowym wydaniu artykułu znalazł się fragment, który wyglądał jak żywcem wyjęty z rozmowy z chatbotem.

- Chodziło o propozycję przygotowania jeszcze bardziej „front-page style” wersji materiału, z mocniejszym układem i bardziej chwytliwym podaniem danych.

Taki tekst nie powinien nigdy trafić do czytelnika. A jednak trafił. Dzień później Dawn opublikował krótką notę redakcyjną. Gazeta przyznała w niej, że materiał był pierwotnie edytowany z użyciem AI, co naruszało jej aktualną politykę. Redakcja dodała też, że tekst zawierał „AI-generated artefact text”, który potem usunięto z wersji cyfrowej. Sprawa miała zostać zbadana wewnętrznie.

Najgorsze? Złamali własne zasady

I właśnie tu robi się naprawdę ciekawie. Problem nie polega wyłącznie na tym, że ktoś zostawił prompt w gotowym materiale. Problem polega na tym, że Dawn już wcześniej opublikował własną politykę korzystania z AI. W tym dokumencie zapisano jasno, że redakcja dopuszcza użycie AI przy researchu, tłumaczeniu, transkrypcji, analizie danych czy materiałach ilustracyjnych. Jednocześnie wprost zakazano używania AI do generowania lub edytowania newsów.

To oznacza, że nie mamy tu do czynienia z niewinnym testem nowego narzędzia. Mamy raczej klasyczny przypadek rozdźwięku między zasadami a praktyką. Redakcja miała reguły. Redakcja je znała. A mimo to ktoś postanowił pójść na skróty. Potem zabrakło jeszcze najprostszego etapu, czyli zwykłego wyłapania kompromitującej wstawki przed publikacją. Właśnie dlatego ta historia jest bardziej o ludziach niż o technologii.

AI nie zawiodła. Zawiódł nadzór

To ważne rozróżnienie. Sztuczna inteligencja sama niczego tu nie „wypchnęła” do druku. Nie podjęła też decyzji, że prompt może zostać w gotowym artykule. To zrobił człowiek albo raczej cały łańcuch ludzi, którzy nie dopilnowali elementarnej kontroli jakości. Narzędzie jedynie zostawiło ślad. Kompromitacja przyszła później, gdy nikt tego śladu nie usunął.

Właśnie dlatego ten case jest tak mocny. Łatwo opowiedzieć go jako tanią historyjkę o „buncie AI w redakcji”. To jednak byłaby bzdura. Ta historia pokazuje coś prostszego i bardziej niewygodnego. W wielu miejscach AI nie zastępuje profesjonalizmu. Ona tylko obnaża jego brak. Jeśli redakcja nie panuje nad procesem, nawet zwykły tekst biznesowy może zamienić się w wiralowy dowód fuszerki.

Wpadka szybko poszła w świat

Sprawę opisał między innymi Newsweek, zwracając uwagę, że błąd szybko zyskał viralowy rozgłos w sieci. Internauci komentowali, jak coś takiego mogło przejść przez papierowe wydanie gazety. I trudno się dziwić. Czytelnik może zaakceptować literówkę, źle przycięte zdjęcie albo niezgrabny tytuł. Ale prompt po AI w gotowym artykule to już nie drobna pomyłka. To sygnał, że ktoś przestał panować nad własnym warsztatem.

Ta historia mówi o mediach więcej, niż się wydaje

Wpadka Dawn nie jest ciekawa dlatego, że wydarzyła się w Pakistanie albo że dotyczyła AI. Jest ciekawa dlatego, że pokazuje mechanizm obecny dziś znacznie szerzej. Media chcą przyspieszać pracę. Szukają skrótów. Testują nowe narzędzia. Problem zaczyna się wtedy, gdy skrót zastępuje myślenie, a procedury istnieją już tylko na papierze. Wtedy jedna linijka zostawiona przez AI potrafi ujawnić dużo większy problem niż zwykła redakcyjna wpadka.

Najuczciwiej byłoby więc powiedzieć to wprost. To nie AI skompromitowała Dawn. Dawn skompromitował się sam. I właśnie dlatego ten przypadek warto zapamiętać. Nie jako anegdotę o chatbocie, ale jako ostrzeżenie dla każdej redakcji, która chce korzystać z nowych narzędzi bez zachowania starej, nudnej, ale koniecznej rzeczy: kontroli.